- DONALD

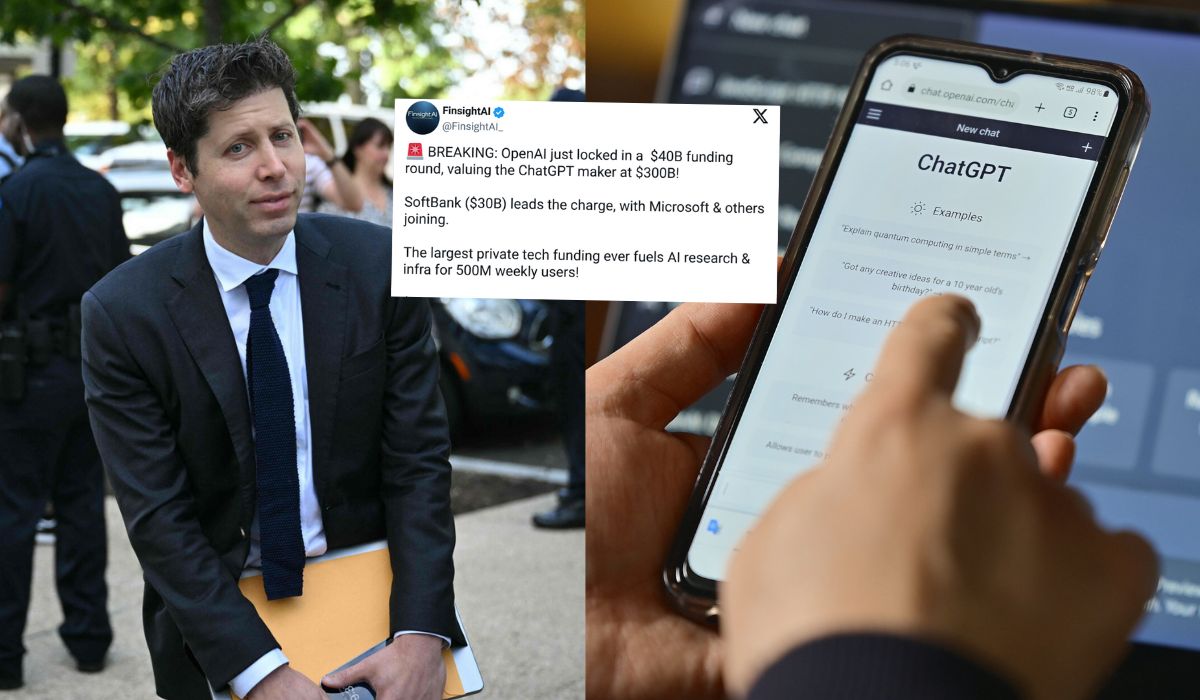

- OPENAI FUNDUJE BADANIA NAD ALGORYTMEM MORALNOŚCI

OpenAI funduje badania nad algorytmem moralności

24.11.2024, 07:30

Fot. Shutterstock

OpenAI przyznało grant naukowy

Uniwersytetowi Duke, by ich badacze przyjrzeli się

sztucznej inteligencji dokonującej moralnych osądów

. Nie podano wiele informacji na temat projektu o nazwie "Badania nad moralnością AI". Wiadomo jednak, że grant dobiega końca w 2025 roku i jest częścią większej, 3-letniej współpracy OpenAI z uczelnią.

Główni badacze projektu, Walter Sinnott-Armstrong oraz Jana Borg, opublikowali wcześniej prace naukowe o potencjale sztucznej inteligencji, która mogłaby służyć jako

"moralny GPS", pomagający ludziom podejmować trudne wybory

. W ramach jednego z badań udało im się opracować algorytm wspierający w podejmowaniu decyzji o tym, kto powinien otrzymać nerkę do transplantacji. Badali także, jakie moralne wybory ludzie woleliby, żeby były podejmowane przez sztuczną inteligencję.

W komunikacie prasowym OpenAI pisze, że prace Uniwersytetu Duke miałyby polegać na

trenowaniu algorytmów tak, aby umiały przewidywać "ludzkie osądy moralne"

w scenariuszach, gdzie dochodzi do konfliktów medycznych, prawnych czy biznesowych.

Jak przypomina portal TechCrunch, w 2021 roku powstał już bot Ask Delphi, stworzony przez organizację non-profit Allen Institute for AI, który miał pomagać właśnie w takich wyborach. Znaleziono jednak wiele sposobów, by go przechytrzyć i jak się okazało, niewielkie parafrazowanie komend prowadziło do tego, że Delphi przyzwalało na duszenie noworodków lub stwierdzało, że bycie heteroseksualnym jest bardziej "moralnie akceptowalne", niż bycie gejem.

Hej, przypominamy tylko:

1. Szanujemy nawet ostrą dyskusję i wolność słowa, ale nie agresję. Przemocowe treści będą usuwane.

2. W komentarzach można swobodnie używać embedów z mediów społecznościowych.

3. Polecamy założenie konta, dzięki temu możesz zobaczyć wszystkie swoje dyskusje w jednym miejscu i dodać coś (👉 Sortownia), co trafi na stronę główną.

4. Jeżeli chcesz Donalda bez reklam, dołącz do naszych patronów: https://patronite.pl/donaldpl

NAJLEPSZE KOMENTARZE TYGODNIA

![Chińskie firmy zaczęły nagrywać filmy obnażające luksusowe marki: "my to szyjemy, a wy płacicie za logo"]()

![Rząd niespecjalnie garnie się do likwidacji Funduszu Kościelnego i podobno szuka innego rozwiązania]()

![Młodzieżowe prawybory w Poznaniu: duża frekwencja, wygrywa Trzaskowski, ale wyniki zaskakują]()

![Zespół Petru proponuje bezkarne posiadanie marihuany: do 15 gieta na własny użytek lub jeden krzaczek]() Więcej popularnych

Więcej popularnych

Popularne dzisiaj

Chińskie firmy zaczęły nagrywać filmy obnażające luksusowe marki: "my to szyjemy, a wy płacicie za logo"

26

Filmiki tego typu stały się popularne po tym jak Donald Trump nałożył cła na ponad 180 krajów. Zobacz więcej »

Rząd niespecjalnie garnie się do likwidacji Funduszu Kościelnego i podobno szuka innego rozwiązania

27

Projekt Lewicy dotyczący likwidacji Funduszu nie został nawet wpisany do wykazu prac rządu. Zobacz więcej »

Młodzieżowe prawybory w Poznaniu: duża frekwencja, wygrywa Trzaskowski, ale wyniki zaskakują

30

Na drugim miejscu znalazł się Adrian Zandberg, a Karol Nawrocki zdobył jedynie 2,8% głosów. Zobacz więcej »

Zespół Petru proponuje bezkarne posiadanie marihuany: do 15 gieta na własny użytek lub jeden krzaczek

46

Projekt ustawy ma być "ponadpartyjny". Zobacz więcej »