- DONALD

- PIERWSZA SZTUCZNA INTELIGENCJA, WSPIERANA PRZEZ ELONA MUSKA, WYCOFANA JAKO NIEBEZPIECZNA

Pierwsza sztuczna inteligencja, wspierana przez Elona Muska, wycofana jako niebezpieczna

16.02.2019, 16:20

OpenAI,

organizacja nonprofit, za którą stoi m.in.

miliarder Elon Musk,

poinformowała, że

nie opublikuje wyników badań nad sztuczną inteligencją GPT2.

Badacze boją się, że

model jest zbyt niebezpieczny

i istnieje zbyt duże ryzyko, że zostanie źle wykorzystany, na przykład do masowej produkcji fake newsów.

GPT2 to generator, który po zasileniu go tekstem tworzy dalszą część historii.

Można wpisać do niego kilka słów lub kilka stron. Ma być lepszy od już istniejących, które gubiły wątek lub

tworzyły zdania niepoprawne gramatycznie.

The Guardian

opisuje, że po wgraniu do generatora artykułu o brexicie, ten stworzył dalszą część tekstu, cytując m.in. słowa Jeremy’ego Corbyna czy rzecznika Theresy May oraz odnosząc się do problemu granicy Irlandii.

GPT2 ma rozumieć tekst dzięki ogromnej bazie nawet 10 milionów artykułów.

Ma również tłumaczyć tekst i robić zwięzłe podsumowania na konkretne tematy.

Przypomnijmy, że dostępny jest już darmowy generator twarzy nieistniejących osób

. Nie byłoby więc trudno stworzyć tysiące (miliony?) nieistniejących autorów milionów tekstów z generatora GPT2:

Hej, przypominamy tylko:

1. Szanujemy nawet ostrą dyskusję i wolność słowa, ale nie agresję. Przemocowe treści będą usuwane.

2. W komentarzach można swobodnie używać embedów z mediów społecznościowych.

3. Polecamy założenie konta, dzięki temu możesz zobaczyć wszystkie swoje dyskusje w jednym miejscu i dodać coś (👉 Sortownia), co trafi na stronę główną.

4. Jeżeli chcesz Donalda bez reklam, dołącz do naszych patronów: https://patronite.pl/donaldpl

NAJLEPSZE KOMENTARZE TYGODNIA

![Niemcy: AfD z rekordowym poparciem, po raz pierwszy prowadzi w sondażach]()

![Musk częściowo wycofuje się z DOGE, chce skupić się na ratowaniu Tesli]()

![Sondaż: Rafał Trzaskowski z kłopotami, Nawrocki zyskuje]()

![USA: w związku z cłami Trumpa liczba turystów zmalała do tego stopnia, że kraj może stracić 90 mld dolarów]() Więcej popularnych

Więcej popularnych

Popularne dzisiaj

Niemcy: AfD z rekordowym poparciem, po raz pierwszy prowadzi w sondażach

27

Tracą natomiast partie, które mają stworzyć nowy rząd. Zobacz więcej »

Musk częściowo wycofuje się z DOGE, chce skupić się na ratowaniu Tesli

23

Od przyszłego miesiąca Musk będzie przeznaczał jeden lub dwa dni w skali tygodnia na sprawowanie obowiązków rządowych. Zobacz więcej »

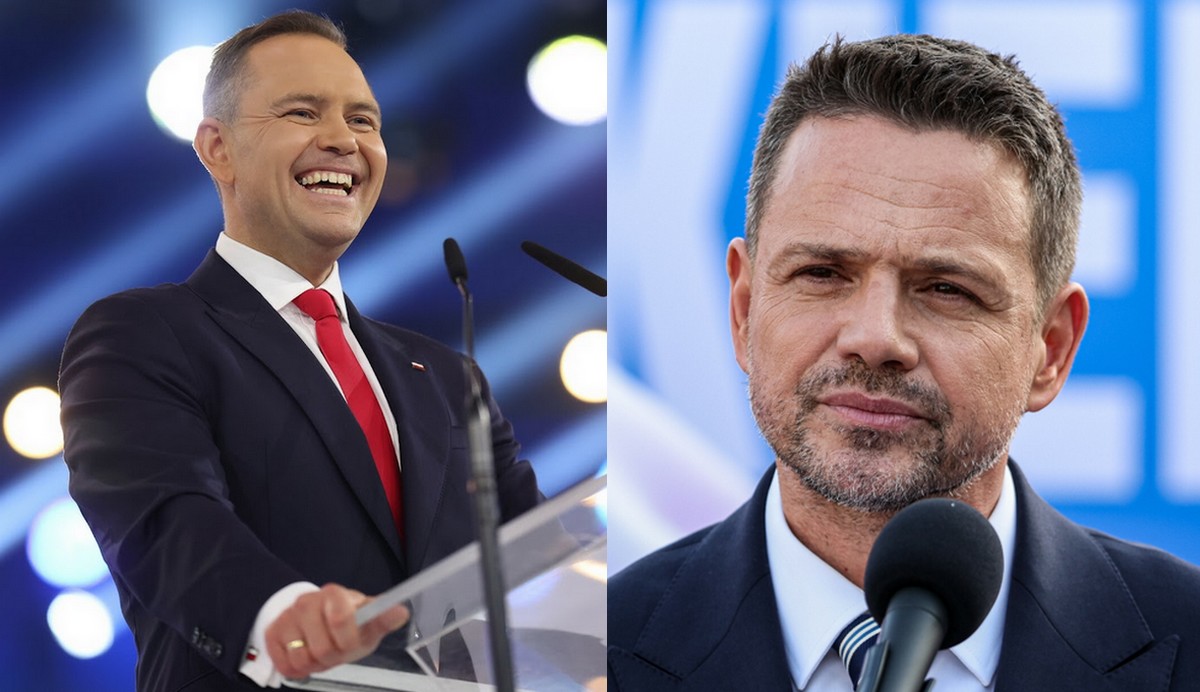

Sondaż: Rafał Trzaskowski z kłopotami, Nawrocki zyskuje

73

Mimo wszystko Rafał Trzaskowski wciąż pozostaje liderem. Zobacz więcej »

USA: w związku z cłami Trumpa liczba turystów zmalała do tego stopnia, że kraj może stracić 90 mld dolarów

31

Stany Zjednoczone są coraz mniej atrakcyjne dla zagranicznych turystów m.in. z powodu polityki handlowej Donalda Trumpa. Zobacz więcej »