- DONALD

- PO W OGNIU KRYTYKI ZA UŻYCIE DEEPFAKE GŁOSU PREMIERA, W ŻADEN SPOSÓB TEGO NIE OZNACZAJĄC

PO w ogniu krytyki za użycie deepfake głosu premiera, w żaden sposób tego nie oznaczając

26.08.2023, 06:30

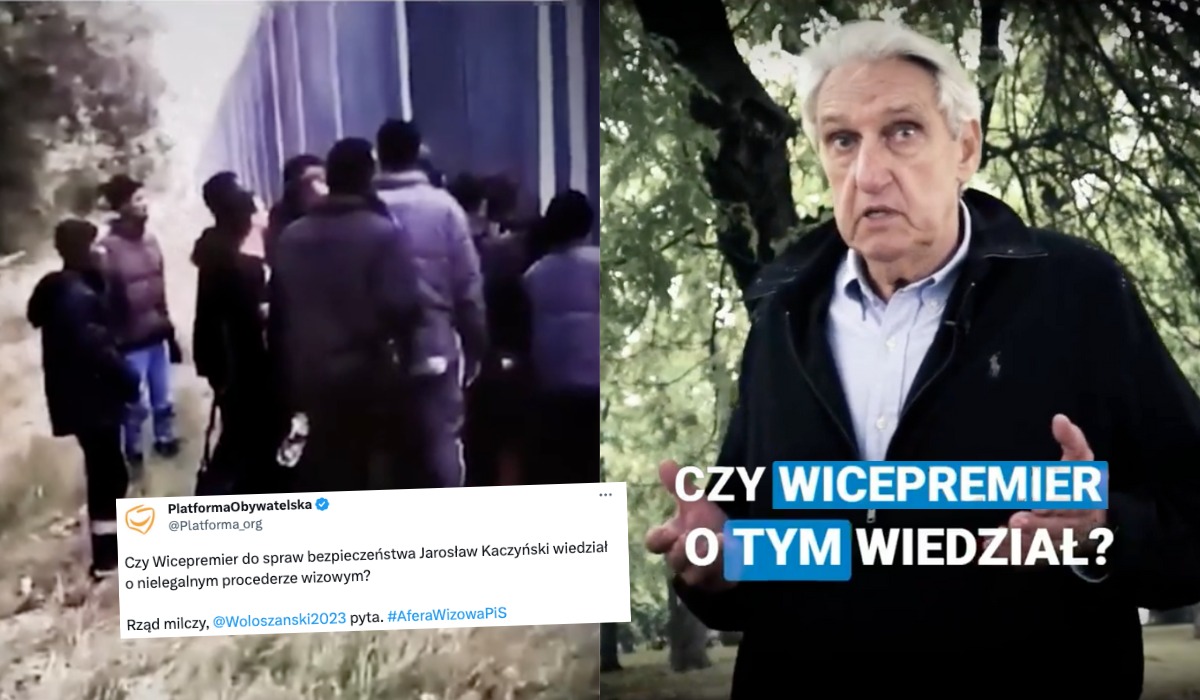

W czwartek na kanałach

Platformy Obywatelskiej

opublikowano spot z serii "Maile Prawdy", nawiązujący do afery z mailami mającymi pochodzić ze skrzynki

Michała Dworczyka. Maile, które pisać miał Mateusz Morawiecki "czyta" on sam - głos premiera został wygenerowany przez

sztuczną inteligencję

. Platforma nie oznaczyła jednak tego faktu w spocie, za co została szeroko skrytykowana.

W spocie zestawiono maile m.in. na temat nielolajności Zbigniewa Ziobry i trudnościach w rządzeniu z wypowiedziami premiera z sejmowej mównicy, w których padały zapewnienia o trwałości Zjednoczonej Prawicy.

W spocie nie oznaczono jednak, że głos premiera został wygenerowany przez AI, co szybko

skrytykowali

eskperci.

"Wrzucenie deepfake z premierem przez największą partię opozycyjną, bez oznaczania tego jako treść syntetyczna, jest strzeleniem sobie w stopę. Bez względu na poglądy polityczne" - napisał na Twitterze

dr Łukasz Olejnik

, ekspert od cyberbezpieczeństwa.

Eksperci są zgodni, że wykorzystanie AI należy jasno oznaczać.

"Uważałabym jednakowoż, że kiedy powstaje klon głosu to należy to oznaczać w samym poście, żeby było jasne, ze to nagranie powstało z wykorzystaniem AI. Trzymajmy się najlepszych standardów w dobie generatywnej sztucznej inteligencji" - napisała

prof. Aleksandra Przegalińska z Akademii Leona Koźmińskiego

.

Michał Podlewski

prowadzący na Twitterze konto o sztucznej inteligencji, działanie PO ocenił jako "nieładne". Zaznaczył, że firmy udostępniające technologię umożliwiającą np. generowanie głosów, podkreślają w regulaminach, że wykorzystanie AI musi być oznaczone przy publikacji. Przypomniał też, że debata dotycząca zagrożeń związanych z użyciem AI w kampanii wyborczej toczy się również w Stanach Zjednoczonych, m.in. za sprawą Republikanów, którzy w kwietniu wypuścili spot z wygenerowanymi przez AI zdjęciami Joe Bidena.

Wczoraj Platforma Obywatelska opublikowała kolejny spot z serii "Maile Prawdy". Tym razem oznaczono już, że głos lektora został wygenerowany przez AI.

Hej, przypominamy tylko:

1. Szanujemy nawet ostrą dyskusję i wolność słowa, ale nie agresję. Przemocowe treści będą usuwane.

2. W komentarzach można swobodnie używać embedów z mediów społecznościowych.

3. Polecamy założenie konta, dzięki temu możesz zobaczyć wszystkie swoje dyskusje w jednym miejscu i dodać coś (👉 Sortownia), co trafi na stronę główną.

4. Jeżeli chcesz Donalda bez reklam, dołącz do naszych patronów: https://patronite.pl/donaldpl

Źródła:

1. https://twitter.com/Platforma_org/status/1694582809875062977?s=20https://twitter.com/Platforma_org/status/1694582809875062977?s=20

2. https://twitter.com/prywatnik/status/1694747370154524923?s=20https://twitter.com/prywatnik/status/1694747370154524923?s=20

Pokaż więcej (3)NAJLEPSZE KOMENTARZE TYGODNIA

![Czechy: premier Babisz zapowiada odwrót od proukraińskiej polityki]()

![Wielka Brytania dopuściła pary jednopłciowe do startów w tańcach na lodzie]()

![Elon Musk niepokoi się o polską dzietność i zapowiada zapaść demograficzną]()

![Unia się odwinęła i wprowadza cło na chińskie paczki z Temu i Shein]() Więcej popularnych

Więcej popularnych

Popularne dzisiaj

Czechy: premier Babisz zapowiada odwrót od proukraińskiej polityki

40

"Nie będziemy udzielać żadnych gwarancji finansowych i nie będziemy nic dawać". Zobacz więcej »

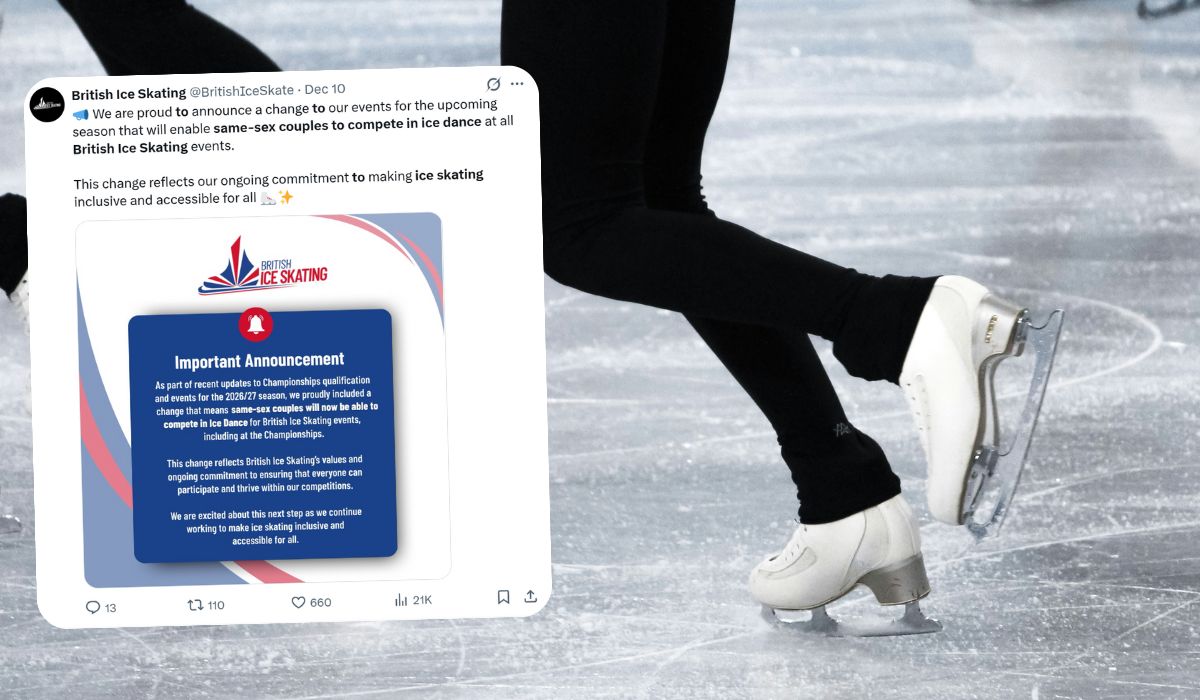

Wielka Brytania dopuściła pary jednopłciowe do startów w tańcach na lodzie

26

Mowa o zawodach na szczeblu krajowym oraz niższym niż krajowy. Zobacz więcej »

Elon Musk niepokoi się o polską dzietność i zapowiada zapaść demograficzną

62

"Przyspiesza się załamanie populacji". Zobacz więcej »

Unia się odwinęła i wprowadza cło na chińskie paczki z Temu i Shein

23

Opłata wyniesie 3 euro i będzie nakładana na produkty trafiające do UE w małych paczkach o wartości do 150 euro. Zobacz więcej »